Google DeepMindが開発するGeminiファミリーの新たなモデル、「Gemini 2.5 Flash-Lite」が正式に大規模な運用に対応可能となったことが発表されました。この発表は、人工知能(AI)技術の進化における重要なマイルストーンを示すものであり、特に低レイテンシ、高スループット、メモリ効率など、実用的なAIソリューションに求められる性能を高水準で実現している点が注目されています。

この記事では、Gemini 2.5 Flash-Liteが持つ主要な特徴、設計思想、実際のユースケース、パフォーマンス比較、さらには今後の可能性について詳細にご紹介します。AI開発者やビジネスリーダーだけでなく、AI技術に興味を持つあらゆる人にとって、理解しやすく有益な情報となることを目指しています。

Geminiシリーズの進化:なぜ「Flash-Lite」なのか?

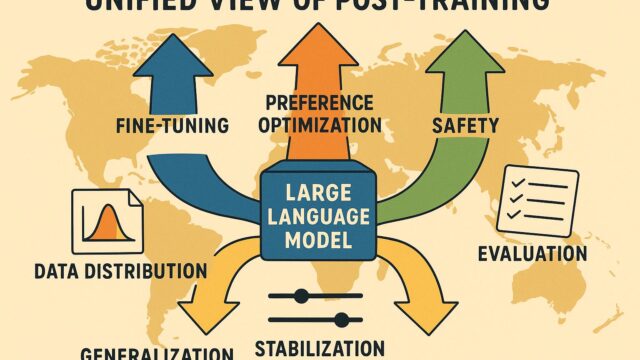

GeminiはGoogle DeepMindが開発を進めてきた大規模言語モデル(LLM)シリーズであり、自然言語処理や生成AIの分野における多くの課題に対応できる先進的なソリューションとして注目されています。Gemini 2.5 Flash-Liteは、その名の通り「軽量」でありながらも、推論性能が非常に高いという特徴を持っています。

「Flash-Lite」というネーミングは、モデルの軽量性と高速性にちなんでおり、従来の大規模モデルに比べて圧倒的に低いレイテンシで応答可能な設計がなされています。これにより、チャットボット、API連携、インタラクティブなWebアプリケーションなどでの実装が格段にしやすくなり、広範な産業用途にも対応可能です。

効率性を追求した設計思想

Gemini 2.5 Flash-Liteは、「高効率・高信頼・柔軟な動作」を設計思想の中心に据えて開発されました。通常、軽量モデルは性能に妥協が伴う場合がありますが、Gemini Flash-Liteはこのジレンマを解消するために、以下のような工夫が施されています。

1. カスタムアーキテクチャの採用:

Gemini 2.5 Flash-Liteは、標準的なトランスフォーマー構造をベースとしながらも、演算効率を最大限に高めるための最適化が行われています。たとえば、メモリ帯域の使用や計算資源の分配に関する最適化によって、同等のパフォーマンスを維持しながら計算コストを大幅に削減することに成功しています。

2. スループットの向上:

特にAPIプラットフォームで利用されることを想定したこのモデルは、一秒あたりに処理できるトークン数(スループット)において非常に高い数値を達成しています。これにより、同時多発的なリクエストが求められる商用用途において、安定かつ迅速な応答が可能となります。

3. メモリ最適化とロバスト性の両立:

モデルが軽量化される一方で、長文入力への対応や文脈保持といった機能性の維持が課題になりますが、Flash-Liteは最新の圧縮アルゴリズムやキャッシュ管理の最適化により、これらの点でも高い性能を発揮しています。

現実のユースケース:どこで使われているのか?

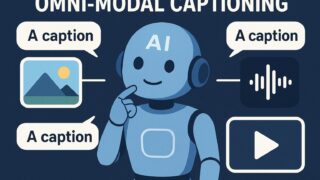

Gemini 2.5 Flash-Liteは、すでに実際の環境で大規模に利用されています。具体的なユースケースとしては、チャットボット、テキストサジェスト、翻訳補助ツールなどが挙げられます。また、企業が独自のアプリケーションにこのモデルを組み込むことで、従来よりもはるかにレスポンスの早いユーザー体験を実現しています。

商用ソリューションでは、API接続を通じてサービス提供されており、クラウドベースのインフラで高速かつ信頼性の高い処理が可能です。さらに、モデルの軽量性と性能のバランスの良さから、エッジデバイスでの利用も視野に入れた応用が検討されています。

ベンチマークから見る性能優位性

DeepMindは、Gemini 2.5 Flash-Liteのパフォーマンスについても詳細なベンチマーク結果を公開しています。以下は代表的なテスト項目と結果の概要です。

– 応答速度(レイテンシ)では、従来モデルの数分の一の時間で回答を生成可能

– 同時リクエスト処理数は大幅に増加し、商用サーバーで数倍のユーザー対応が可能に

– 簡易なデプロイメントが可能で、開発者やエンジニアがすぐに組み込み・検証できる設計

一部の評価では、大規模モデルに匹敵する応答精度を軽量モデルで実現しているとされ、これは実用的なAI活用において極めて大きな意味を持ちます。

開発者向けの機能と体験

Gemini Flash-Liteは、API連携を通じて世界中の開発者が簡単に利用できるように設計されています。Google CloudやGemini APIプラットフォームと統合されており、RESTfulな通信によって迅速な構成とスケーリングが可能です。

また、開発者向けドキュメントが非常に充実しており、サンプルコード、使用例、問題解決のためのガイドラインが丁寧に提供されています。これにより、AI開発に不慣れなエンジニアでも手軽にこの最新AIの恩恵を受けられるようになっています。

テルストラ、ショッピファイ、アトラシアンなど、多数の商用サービスに統合されており、実績面でも信頼できるモデルといえるでしょう。

未来への道筋:AIの民主化へ

Gemini 2.5 Flash-Liteの登場は、AI技術が特定の研究機関や巨大企業に留まらず、より多くの人々が手に取りやすいものへと変わりつつある兆しでもあります。なぜなら、このような高性能で軽量なAIモデルが誰でも利用可能になることで、中小企業、教育機関、地域コミュニティなど多様なプレイヤーが自らの課題をAIで解決する手段を得られるからです。

また、スピードだけでなく、エネルギー効率やコストパフォーマンスという観点でも大きな意味を持ちます。サステナブルなAI活用を実現しやすくなることで、テクノロジーの進化と環境意識の両立といった現代的課題にも貢献し得るのです。

まとめ

Gemini 2.5 Flash-Liteの登場は、高性能と効率性を両立させたAIモデルの新たなスタンダードの幕開けを意味します。軽量でありながら高精度、迅速でありながら低コスト。これらの条件を全て満たすことは容易ではありませんが、DeepMindはその挑戦を見事に果たしました。

これからの時代、AIはより身近で便利な「道具」として社会に浸透していくことでしょう。Gemini 2.5 Flash-Liteは、その大きな一歩であり、AI活用の新しい時代の扉を開く鍵となるモデルです。

AI技術の進歩はとどまるところを知りませんが、その恩恵がより多くの人に届くようになるためには、技術の民主化が不可欠です。その意味で、本モデルは技術の進化だけでなく、その社会への応用・貢献という観点でも象徴的な存在といえるでしょう。