近年、生成系AI(Generative AI)は著しい進化を遂げており、特に自然言語を用いて構造化データへアクセスする手段として注目を集めています。生成系AIの主な強みの一つは、従来のキーワードマッチングや定型クエリ作成とは異なり、人間の言語に近い自然な問い合わせに柔軟に応答できることです。これにより企業や開発者がユーザーにより直感的なデータアクセスのインターフェースを提供することが可能になっています。

今回取り上げるのは、AWSの公式ブログで紹介された「Choosing the right approach for generative AI-powered structured data retrieval(生成AIを用いた構造化データ検索のための適切なアプローチの選び方)」という記事です。この記事では、生成AIを活用して構造化データ(たとえばリレーショナルデータベースやデータウェアハウス)にアクセスする際に考慮すべきさまざまなアプローチと、それぞれの利点や課題について詳しく解説されています。

本記事では、AWSが提案する複数のアーキテクチャ例を紹介しながら、実際にどのようなケースでどのアプローチが適しているのかについて丁寧にまとめていきます。

構造化データへの自然言語によるアクセスの需要

構造化データは、企業活動における膨大な情報源の中核を担っています。売上データ、カスタマー情報、センサーデータなど、日々膨大な量の情報が様々なフォーマットで蓄積されていきますが、それらの情報はSQLなどの記述言語を通じて取得するのが主流でした。

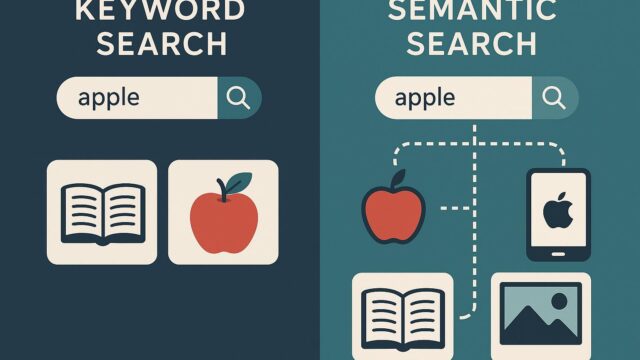

しかし、SQLを使いこなせる人材は限られており、非技術者にとっては一つのクエリを作成するだけでも学習コストや時間がかかることがあります。こうした背景もあり、自然言語で「今月の売上が先月比でどれだけ増減したか教えて」といった問いを投げるだけで適切なクエリを生成し、必要な情報を返してくれる仕組みへの期待が高まっています。

生成AIが登場したことで、従来の課題に対して新たな解決策が見えてきました。特に大規模言語モデル(LLM)は、ユーザーの意図を自然言語から読み取り、適切なデータクエリに変換する能力を持つようになってきています。

大まかな3つのアプローチ

AWSが提案する生成AIによる構造化データ検索のアプローチは、大まかに以下の3つに分類されます。

1. LLMが直接クエリを生成して実行するアーキテクチャ

2. LLMがユーザーの意図を理解し、事前定義されたテンプレートにマッピングするアーキテクチャ

3. LLMを使ってメタデータやデータベースのスキーマに基づき、ユーザーの発言をベクトル検索で類似検索するアーキテクチャ

それぞれの特徴を見ていきましょう。

1. LLMによる直接クエリ生成

最もシンプルなアプローチは、ユーザーによる自然言語の問い合わせをLLMが解釈し、直接SQLなどの構造化クエリを生成して実行する形式です。スキーマ情報などを入力に含めてLLMに問い合わせることで、文脈に適したクエリを返すことが可能です。

【メリット】

– ユーザーフレンドリーで直感的。

– 様々なフレーズや語彙に柔軟に対応できる。

【デメリット】

– LLMが生成したクエリの正確性や安全性に注意が必要。

– 誤ったクエリによるデータの誤取得、またはセキュリティリスクが生じうる。

– スキーマが複雑な場合、LLMの負担が増大。

2. 意図の識別とテンプレートとのマッピング

次に紹介されたのは、LLMがユーザーの発話から「意図(Intent)」を抽出し、それに対応するクエリテンプレートへマッピングする方式です。たとえば「先月の売上データが知りたい」という要望が来た場合、それを「売上取得」という事前定義されたテンプレートへ変換します。そこに必要なパラメーター(日付や商品など)をユーザーの発話から抽出して埋め込みます。

【メリット】

– 決められたテンプレートを使うため、クエリの安全性が高い。

– 意図の識別による柔軟な応答が可能。

– コンテキスト検出によって、ユーザーの曖昧な質問への対応も一部可能。

【デメリット】

– ナレッジやテンプレートが不足している場合、カバーしきれない可能性がある。

– 新たな意図を追加するにはテンプレートの拡張が必要。

3. メタデータやスキーマによるベクトル検索の活用

このアプローチでは、まず構造化データに関するメタデータ(たとえばテーブルの説明やカラム名など)を事前にベクトル化し、ユーザーの自然言語による問いと類似性の高い情報を検索します。この検索結果を元にLLMが適切な応答やクエリを生成します。

【メリット】

– 大規模なデータベースや多様なスキーマに拡張しやすい。

– ユーザーが曖昧な表現を使った場合でも、類似情報のヒットにより精度が出やすい。

【デメリット】

– ベクトルDBやエンベディングの構成など新たな技術要素が必要。

– 実装の複雑度が増す。

ハイブリッド型による統合アーキテクチャの提案

AWSのブログ記事では上記3つのアプローチを単独で採用するのではなく、複数のアーキテクチャを組み合わせた「ハイブリッド型」の導入も提案されています。

たとえば、まずユーザーの発言をベクトル検索によって意図に合致するテンプレート候補を抽出し、そのテンプレートをLLMで補強してクエリを生成する、といったフローが考えられます。これにより、クエリの正確性・汎用性・操作の安全性を高いレベルでバランスさせた実装が可能になります。

Amazon Bedrock を用いた実装例

AWSでは、これらのアーキテクチャを容易に実現するためのサービスとしてAmazon Bedrockを例に挙げています。Bedrockではさまざまな基盤モデル(Foundational Model)を活用しつつ、マネージドな環境でLLMの活用が可能です。

さらに、Amazon AuroraやAmazon Redshift、Amazon Athenaなどのデータベースサービスと連携することで、ユーザーは自然言語で問い合わせても、その背後で精密な構造化クエリが実行されるような環境を構築できます。

今後の展望と課題

生成AIと構造化データの融合は、今まさに急速に進展している分野であり、大きな可能性を秘めています。一方で、安全性や誤解釈防止、セキュリティ対策など、多くの技術的・運用的課題も存在します。

どのアプローチが最適かは、利用ケース、市場要求、社内リソースに応じて全く異なります。また、導入に際しては、ユーザーからの問い合わせ履歴の分析や、継続的な精度改善も求められます。

まとめ:最適解は一つではない

構造化データに対する自然言語インタフェースの構築においては、「明確な正解」はなく、目的や制約に応じて最適なアーキテクチャを選ぶことが重要です。AWSが提案する3つのアプローチは、それぞれが特定の強みを持ち、それぞれ適したユースケースを持っています。そしてそれらを柔軟に組み合わせることで、自然言語検索における高いユーザー体験と正確性を両立することが可能です。

生成AIの導入は決して「魔法」ではありませんが、その力を理解し、適切に選び取り、堅牢な枠組みに組み込むことで、構造化データの利用体験は新たな段階へと進化していくはずです。今後ますます便利になる自然言語インターフェースの発展を、我々も積極的にキャッチアップしていくことが求められています。