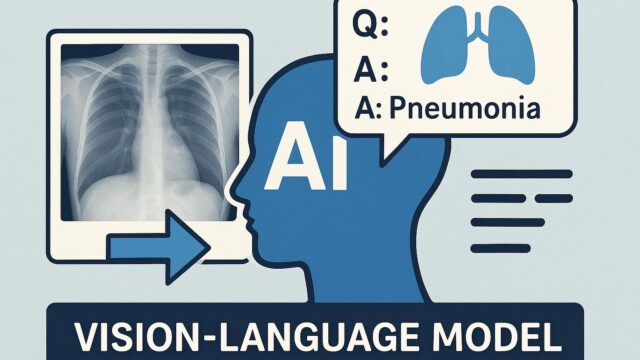

近年、画像と言語を組み合わせて情報を処理する「ビジョン・ランゲージ・モデル(VLM:Vision-Language Models)」の精度が飛躍的に向上しています。画像認識や質問応答、画像のキャプション生成、動画理解など、VLMが担えるタスクの幅も広がっています。

しかし、映画や映像作品において非常に重要な「シネマトグラフィー(撮影技術・映像文法)」の理解、つまり、カメラワーク、構図、照明、空間の使い方など、映像を構成する表現技法をAIがどこまで理解できるかという点については、これまでの研究ではほとんど評価されてきませんでした。

この重大なギャップを埋めるために、新たに提案されたのが「ShotBench(ショットベンチ)」です。

ShotBenchとは何か?

ShotBenchは、VLMが「映画の文法(cinematic grammar)」をどれほど深く理解できるかを評価するためのベンチマークデータセットです。Oscarノミネート作品を含む200本以上の名作映画から選び抜かれた画像や動画クリップが素材として使われており、それに対応する約3,500件の専門家による質問応答ペア(QAペア)が含まれています。このデータセットは、次の8つの「シネマトグラフィーの側面」を網羅しています:

1. カメラアングル(Camera Angle)

2. フレーミング(Framing)

3. 動き(Motion)

4. 被写界深度(Depth of Field)

5. ライティング(Lighting)

6. 色彩設計(Color Design)

7. 空間関係(Spatial Relationship)

8. 映像の構図や配置における意味の理解(Composition & Semantics)

これにより、従来の単純な視覚認識とは異なる、きわめて芸術的かつ文脈依存の要素について、AIがどこまで人間に近づいているかを測定できます。

現行のトップAIでさえ及ばない精度

研究チームは、ChatGPTのような大規模AIや画像生成AIの骨組みにあたる24の代表的モデルにこのShotBenchを適用して精度を評価。すると、最高スコアのモデルでさえも平均正答率は60%未満という結果に終わりました。特に弱かったのは、「空間的推論」や「微細な視覚表現の解釈」です。例えば、あるシーンのカメラ構図が登場人物の心理状態や物語の伏線をどう示しているかといった、映画的な文脈の読み取りが不十分だったということです。

これは、現在のVLMが一般的な視覚認識(犬が写っている、建物がある等)には強くても、「なぜこのカメラアングルが使われているのか」といった撮影意図の読み込みや芸術的解釈にはまだまだ力不足であるということを示しています。

より高度な理解のために:ShotQAとShotVLの開発

この課題を解決するため、研究チームは新たに「ShotQA」と呼ばれる大規模な質問応答型データセットを構築しました。そこには約70,000件にも及ぶシネマティックなQAペアが含まれており、多くの映像表現における緻密な問いかけがなされています。

さらにこのデータセットを使って、既存のVLMを「Fine-tuning(微調整)」し、シネマトグラフィーの理解に特化させたモデル「ShotVL」を開発しました。この微調整プロセスでは、「Group Relative Policy Optimization(GRPO)」という新しい学習手法も採用されています。これは強化学習的なアプローチで、より効果的に“理解の深さ”を訓練できる点が特徴です。

結果として、ShotVLモデルは既存のオープンソースおよび商用の最先端VLMを大きく上回るパフォーマンスを示し、ShotBench上で新たな最高評価を記録しました。

オープンソース化による未来の加速

この研究の意義は技術的な成果だけでは終わりません。ShotBench、ShotQA、ShotVLのすべてのデータと学習済みモデル、コードなどはオープンソースとして公開されています。これにより、世界中の研究者や開発者が平等にこの研究成果を再利用・拡張できるようになります。

技術的視点でのコメント

VLMの強みは「大量の画像と言語のペアからの学習」にありますが、「映画」のように芸術的かつ文脈依存の強いデータを意味的に解釈するには、従来の汎用学習だけでは不十分です。特に映画においては、人物の立ち位置一つ、照明の違い、レンズの画角が象徴的な意味を持ちます。こうした情報は明示的に説明されない「暗黙のルール」でもあり、人間は文化・教養・経験からそれらを総合的に理解します。

AIにこのレベルの表現理解を追いつかせるには、“表現のための学習”が今後のカギになるでしょう。その第一歩がShotBenchであり、モデル理解における新たな評価軸を築いたとも言えます。

今後の展望

映画業界では、脚本補助、映像編集、シーン提案などAIの導入が始まっていますが、AIがより高度な支援を行うためには、撮影設計や映像文法の理解が必要不可欠です。この研究が今後、映画制作へのAI活用を一層促進し、また教育分野や映像アーカイブの自動解釈にも応用されていくことが期待されます。

一方で、人間の感情や文化的背景に深く結びついた表現をいかにAIが読み解くべきかという点では、倫理や芸術の定義といった新たな論点も浮上しています。AIとアートの境界をどのように設定していくのか──今後の議論と研究が待たれます。

参考元:ShotBench, ShotQA研究論文(https://arxiv.org/abs/2506.21356)