サイバーセキュリティの世界では、脅威モデリング(Threat Modeling)が極めて重要です。組織が新たなアプリケーションやサービスを開発・運用する際、その設計段階から潜在的なセキュリティ上の脅威を予測し、対処策を講じておくことは非常に大切です。しかしながら、従来の脅威モデリング手法は、時間と労力がかかることに加え、専門的なスキルが求められるため、多くのチームにとってはハードルが高いものでした。

そこで今、注目されているのが「生成AI(Generative AI)」を活用した脅威モデリングの高速化です。本記事では、AWS(Amazon Web Services)が公開したブログ記事「Accelerate threat modeling with generative AI」をもとに、生成AIによってどのように脅威モデリングが加速され、効率的かつ実用的になるのかを詳しくご紹介していきます。

脅威モデリングの基本

まず最初に、脅威モデリングとは何かを簡単におさらいしておきましょう。脅威モデリングとは、システムの設計段階で予測されるサイバー脅威やセキュリティのリスクを特定し、それに対する対処策(緩和策)を講じるプロセスのことです。開発のライフサイクルにおいてできるだけ早期に実施することで、後々の大きな問題を未然に防ぐことができます。

代表的な脅威モデリング手法としては、Microsoftが提唱する「STRIDE」モデル(Spoofing, Tampering, Repudiation, Information Disclosure, Denial of Service, Elevation of Privilege)などがあります。このような体系だったフレームワークでは様々な観点からセキュリティリスクを整理しやすくなりますが、実際にはシステム全体の構造を正確に把握し、それに対して体系的な分析を行う必要があるため、かなりの時間と専門知識が必要になるのが現実です。

なぜ脅威モデリングの効率化が求められるのか?

現代のアプリケーション開発は、より高速に、より柔軟に進められる傾向があります。アジャイル開発、DevOps、クラウドネイティブといったトレンドは、開発スピードと頻繁なリリースを前提としています。このような環境では、セキュリティ対策を後付けで行うのでは遅く、開発と並行してセキュリティも重点的に考慮する「セキュリティ・バイ・デザイン」の考え方が強く求められるようになっています。

しかし現実には、セキュリティ専門の人材は不足しており、すべての開発チームに専属のセキュリティ担当がつくとは限りません。さらに、従来の脅威モデリングは時間と労力がかかるため、開発スピードに追いつかないという課題もあります。

こうした状況の中において、生成AIの力を活用することによって、脅威モデリングをより効率的に、開発と同じスピード感で行えるようにすることが重要になってきています。

生成AIによる脅威モデリングの加速

AWSは、2023年のSecurity Lake、GuardDuty RDS Protectionsなどのセキュリティサービスの強化に続き、脅威モデリングのプロセスそのものを生成AIで支援する取り組みを開始しています。ブログ記事「Accelerate threat modeling with generative AI」では、実際のユースケースとともに、AWSがどのように生成AIを活用しているのかにフォーカスしています。

AWSでは、脅威モデリングのプロセスにおいて、大規模言語モデル(LLM: Large Language Model)を活用して以下のようなタスクを支援しています。

ユーザー入力に基づきアーキテクチャを自動的に解釈:

開発者が記述したシステムアーキテクチャや構成、ユースケースなどの自然言語的な情報をAIが解釈し、自動的に構造を理解します。これにより、従来は人手で行っていた設計内容の把握にかかる時間を大幅に短縮できます。

潜在的な脅威の抽出:

LLMは、トレーニングされた豊富なセキュリティ知識に基づき、与えられたアーキテクチャに対してどのような脅威が潜在しているかを推論できます。例えば、特定の通信経路が暗号化されていないことによる情報漏えいや認証プロセスの不備による不正アクセスの可能性など、実際のリスクにつながる要素を的確に指摘することが可能です。

推奨される緩和策を提示:

単に脅威だけを示すのではなく、それに対してどのような緩和策を講じるべきかも提案します。例えば「IAMポリシーの最小権限の原則を守るべき」や「API GatewayにWAFを適用すべき」といった実践的なアドバイスが得られるのです。

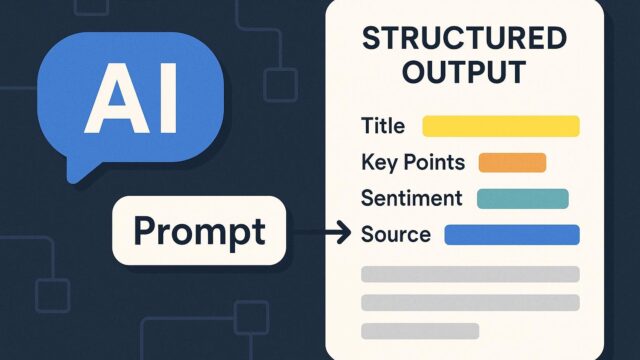

脅威モデリングのレポート作成を自動化:

AIは、分析結果をレポート形式でまとめることもできるため、ドキュメントとしてのアウトプットも管理しやすくなります。セキュリティチームはそれをもとに対策の優先順位づけやレビューを効率的に行えます。

実際のユースケースと可能性

AWSは、こうした生成AIを活用した脅威モデリングプロセスを実証すべく、複数のチームと協力して実践的なテストを行っています。たとえば、開発チームが自身のアーキテクチャ図や仕様を簡単な文章で提示するだけで、LLMがその内容を読み取り、STRIDEに準拠した脅威一覧と、その緩和策を提示するといった使い方がされているのです。

この結果として、従来ではセキュリティエンジニアが数時間かけて行っていた分析作業が、ごく短時間で実現可能となりました。また、いくつかのプロジェクトでは、セキュリティ初心者の開発者でも、生成AIのサポートを通じて効果的な脅威モデリングを実施できるようになったとのことです。

さらにAWSは、このような生成AIの活用を「早期・頻繁な脅威モデリング」の実現に繋げており、アジャイルやCI/CD環境における継続的なセキュリティ診断プロセスに統合する道も視野に入れています。これにより、セキュリティが開発サイクルから切り離されることなく、より自然に開発プロセスの一部として組み込まれていくようになるのです。

限界と今後の展望

もちろん、生成AIによる脅威モデリングが完璧であるとは言えません。AIは万能ではなく、誤った判断を下す可能性や、前提条件や環境設定を誤解するリスクがあります。したがって、AIの出力を鵜呑みにするのではなく、セキュリティ専門家のレビューを組み合わせることが重要です。これは、AIと人間の協働による「ハイブリッド型」のアプローチと言えるでしょう。

しかしながら、今後AIがさらに進化し、特定の業種や案件特有の知識を学習していくことで、さらに精度が高く、業務にマッチしたアシストが可能になると考えられています。また、ユーザー企業自身が自社独自のドメイン知識でLLMをカスタマイズする「ファインチューニング」も可能となれば、より柔軟かつ実践的な活用が見込まれます。

まとめ:セキュリティの民主化に向けた一歩

生成AIによる脅威モデリングの高速化は、これまでセキュリティ専門家の手に委ねられてきた高度な分析作業を、より多くの開発者が日常的に実施できるようにするという点において、「セキュリティの民主化」を推進する素晴らしい取り組みだと言えます。

AWSが提供するこのようなAI支援ツールの普及によって、誰もが簡単に、かつ的確なセキュリティ判断を行えるようになれば、ソフトウェアの安全性は一層高まり、サービス利用者にとっても安心感を持てる世界へと近づくことになります。

セキュリティは誰か一人の責任ではなく、チーム全体、企業全体で担うべきものです。生成AIを活用して脅威モデリングの負担を軽減することで、開発者、セキュリティ担当者、運用チームのすべてが協力しやすくなり、より強固なセキュア開発体制を築くことができるでしょう。

これからの時代、私たちがより良いテクノロジーを創造していくためには、セキュリティも同時に進化していく必要があります。そして、生成AIはその進化を力強く後押ししてくれるはずです。