要点と背景:軽量な「安全注入」でアライメントを増幅する

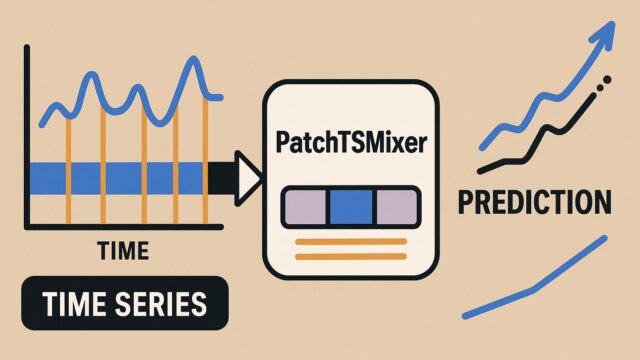

論文タイトル「Turning the Spell Around: Lightweight Alignment Amplification via Rank-One Safety Injection」が示唆するのは、従来の高コストなRLHFやフルファインチューニングに頼らず、ランク1(rank-one)という極小のパラメータ注入で大規模言語モデル(LLM)の安全性を増幅する手法です。ざっくり言えば、モデル内部の特定の層に「安全方向ベクトル」を外積で注入し、出力の傾きを安全側へ小さく素早く“押しやる”発想。推論時パッチあるいは低コスト微調整として適用でき、既存モデルの能力を大きく落とさずに安全性を底上げすることを狙います。

タイトルの“Turning the Spell Around”は、ジェイルブレイク系の“呪文(spell)”に対して、そのベクトル方向を見極め、逆向きの安全方向で相殺・補正するニュアンスとも読めます。LoRAやROMEに通じる低ランク・局所編集の系譜を、アライメント強化に振り向けた軽量アプローチと捉えると理解しやすいでしょう。

主流解釈とのズレ:本稿が読み取った3つのポイント

- 重い学習から軽い注入へ:主流はRLHFや大規模再学習による安全強化。一方、本論文が示す方向は、ランク1の行列注入や小規模の線形ステアリングで「後付け」的に安全性を増幅する点。コスト構造が根本的に軽くなります。

- 外側のガードから内在化へ:主流の現場は外付けフィルタやガードレールで安全を担保しがち。本手法は内側の表現空間を直接整えるため、検知・遮断ではなく「出力の生成過程そのものを安全側へ」シフトしやすい。

- ブラックリストから連続ベクトルへ:単語禁止やルール列挙ではなく、ジェイルブレイクの“方向”を連続的に捉え、逆方向に微調整する考え方。これにより未知の攻撃パターンにも一般化しやすい可能性がある。

そのズレが意味すること:短期と中期のインパクト

- 短期(数週間〜数ヶ月)

- 小規模チームや企業でも、既存LLMに軽量パッチを当てる運用が現実味。安全性テスト→ランク1注入→再テストの迭代サイクルが高速化。

- 外付けフィルタの誤検知(false positive)依存からの脱却。生成品質を大きく落とさずに有害出力率の低減が狙える。

- プロダクトA/Bテストで、拡張子のように安全パッチを切替・併用して効果検証しやすくなる。

- 中期(1〜3年)

- 安全性向上のノウハウが「安全方向ベクトルのレシピ化」へ。ドメイン別・地域規制別の安全プロファイルをモジュールとして配布・適用するエコシステムが生まれる可能性。

- 規制順守(コンプライアンス)や監査において、「どの層に何の方向をどれだけ注入したか」という説明可能な運用ドキュメントが標準化。

- モデル更新のたびに大量再学習しなくても、軽微な安全リグで追随可能。運用コストと環境負荷の削減が期待される。

日本・グローバル経済や社会課題との関係

日本の中小企業や自治体の現場では、GPUや学習データの制約から「安全な生成AI」を内製しづらい課題があります。軽量なランク1注入は、既存のOSSモデルや商用API出力に対して相対的に低コストで安全度を上げる選択肢を提供します。グローバルでは各地域の規制・文化的文脈に合わせた「安全プロファイル」の切替需要が高まっており、モジュール式の安全方向ベクトルは適用可能性が高い。結果として、デジタル・ディバイドの緩和や、教育・医療・行政など公共分野での安全なAI活用に寄与しうるでしょう。

実装の勘所(私見を含む)

ここからは実務的な視点です。モデルの特定層(例:MLP出力やAttentionの投影)に対し、vとuの外積v u^Tを小さな係数で注入するだけでも、生成の方向付けが可能です。安全方向ベクトルの学習は、簡易な識別器やペアワイズ比較(安全/非安全の好み方向)から導けます。評価は次の3点を同時に見ると良いでしょう。

- 攻撃耐性:ジェイルブレイク成功率、誘導に対する拒否率の改善。

- 有用性維持:通常プロンプトでの有益応答の質低下をどれだけ抑えられたか。

- 一般化:未知の攻撃テンプレートや異ドメインでも安全性が保てるか。

運用面では、複数の安全方向(例:有害言説、個人情報、医療助言、著作権)を別々のランク1成分として管理し、状況に応じてオン/オフや重みを調整する「モジュール安全化」が有効です。A/Bテストでユーザ影響を観測し、過度な抑制(オーバーブロッキング)があれば係数を下げる、といったフィードバック制御も容易になります。

限界と注意点

- 過度の抑制:安全方向が強すぎると、専門的・合法的な相談まで遮ってしまうリスク。係数スケールと適用範囲のチューニングが必須。

- 分布ずれ:学習時の安全データと実運用の問い合わせ分布が異なると、方向ベクトルが想定外の挙動を誘発する場合がある。

- 攻撃の進化:対策に適応して攻撃も進化。定期的な評価セット更新と、複数方向の併用(エンサンブル的注入)が望ましい。

ここが独自解釈だ(筆者の見解)

- ランク1注入は「安全の内在化」と「柔軟な運用」の両立点になりうる。特に、用途別プロファイルとして安全方向を切替える設計は、規制遵守と顧客体験を同時に最適化できる。

- 複数の安全方向を直交化して管理すれば、干渉を減らし、デバッグ性が上がる。ここは今後の実務Tipsとして重要になる。

- マルチモーダル(音声・画像)でも、ランク1注入の思想は有効。表現空間の局所方向付けは modality に依存せず応用可能だと考える。

見逃されがちなポイント

- 監査ログ:どの安全方向を、どの係数で、どの時間帯に適用したかのメタデータは、後方監査や事故調査の生命線。軽量でもガバナンス設計は重視を。

- 端末側推論:エッジ実行のLLMに小さな安全ベクトルを同梱できれば、クラウドへ敏感情報を送らずに現場安全性を確保しやすくなる。

- 人間中心設計:安全は技術だけでは完結しない。ユーザに“なぜ答えられないか”を丁寧に返すUXとセットで価値が最大化する。

おすすめの実務リソース

実装や評価の基礎体力をつけるには、深層学習の表現学習や最適化に強くなるのが近道です。以下は土台を固めるのに有用な書籍です(画像は出版社提供)。

まとめ

Rank-One Safety Injectionは、LLMの安全性を「重い再学習に依存しない方法」で底上げする可能性を示します。安全方向ベクトルを特定し、ランク1で注入する──その小さな操作が運用の俊敏性と説明可能性を同時に引き上げます。短期はコストと実装容易性の恩恵が大きく、中期は安全プロファイルの標準化・流通といった新たな生態系の芽が出るでしょう。リスク管理と人間中心のUXを忘れず、軽量なアライメント増幅を実務に取り入れていくことが、現場での価値最大化につながります。