- Amazon: Raspberry Pi 5(8GB)

- Amazon: NVIDIA Jetson Orin Nano Developer Kit

- Amazon: Docker/Kubernetes 入門書(日本語)

- 楽天: Raspberry Pi 5(8GB)

- 楽天: NVIDIA Jetson Orin Nano Developer Kit

- 楽天: Docker/Kubernetes 入門書(日本語)

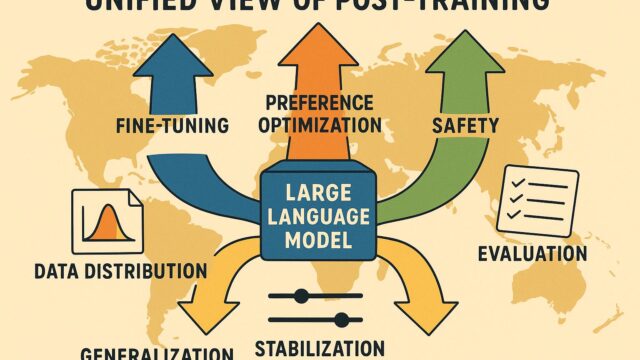

MCP-Benchとは何か:ツール使用エージェントを「現実の仕事」で測る

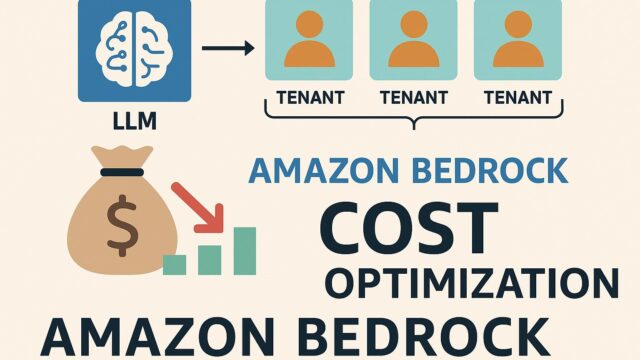

LLMエージェントがメール、カレンダー、データベース、ブラウザ、Git、ファイルシステムといった外部ツールを駆使してタスクを完遂する――そうした“現実の仕事”をどの程度、正確かつ安全にこなせるかを、共通の土俵で測るための評価基盤がMCP-Benchです。中核にあるのはMCP(Model Context Protocol)サーバー。各ツールをMCPサーバーとして標準化し、エージェントは統一インターフェースで呼び出します。これにより、同一のタスク仕様・同一のツール群・同一の評価ロジックで、モデルや実装の違いを公平に比べられるようになります。

なぜ必要か:プロンプトテストだけでは「現場の難しさ」が見えない

LLMの評価はプロンプト応答の正解率に偏りがちですが、実運用では以下の課題が支配的です。

- ツール呼び出しの信頼性(再試行、エラー回復、部分的成功からのリカバリ)

- 安全性と権限管理(最小権限、シークレット管理、書き込み操作のガードレール)

- 観測性(どのツールを、いつ、なぜ呼んだのかを追跡できるログとメトリクス)

- 再現性(環境差異・バージョン差・ネットワークの揺らぎをどう抑えるか)

MCP-Benchは、課題定義から実行環境、採点方法までを定式化し、上記の「現場のむずかしさ」を測れるメトリクスへと落とし込みます。

設計のポイント:標準インターフェース、コンテナ化、明確な採点

- 標準化されたツール層:ブラウザ、ファイルI/O、カレンダー、メール、DB、Git、タスク管理(Issue/Jira/Asana相当)などをMCPサーバーとして提供。エージェントはMCPのツール・リソース・会話チャネルを通じて操作します。

- コンテナ化された実行環境:Docker等で各タスク環境を固定化。入出力、ネットワーク条件、テスト用データセットを同梱し、再現性を担保します。

- タスク仕様の機械可読化:YAML/JSONで前提、制約、評価方法、成功条件、部分点ルールを定義。ヒト検証が必要な箇所はガイドラインに基づいて軽量レビュー可能に。

- 可観測性の内蔵:全てのツール呼び出し、引数、戻り値、エラー、リトライ、思考過程の要約などを構造化ログに記録し、デバッグと研究の両方を支援。

代表的タスクの例

- 業務秘書タスク:会議招集、出席者の空き時間探索、議題の整理、カレンダー登録、フォローアップメール送信

- データ活用タスク:CSV/DBからの集計、可視化画像の生成、結果のレポート化、レビュー依頼の送付

- 開発支援タスク:仕様チケットの要約、関連Issueリンク、リポジトリの検索、パッチ候補の作成、PRの下書き

- 調査・執筆タスク:信頼できる情報源の抽出、引用管理、草稿生成、体裁の統一、納品フォーマットへの出力

評価指標:正確さだけでなく「現場力」を点数化

- 成功率(タスク達成の有無、部分点を含む)

- ツール呼び出し精度(適切なツール選択、引数妥当性、順序の正しさ)

- 効率性(完了までのステップ数・時間・APIコスト・外部呼び出し回数)

- 回復力(失敗時のリトライやフォールバックの質、冪等性の担保)

- 安全性(過剰権限要求の回避、機密情報の扱い、危険操作のガード)

得られた知見(要旨)

- ツールが非決定的な環境では、同一モデルでも成績が大きく揺らぐため、サーバーの決定論性とテストデータ固定が重要。

- 「まず全体計画を作る→逐次実行→結果に基づく計画更新」という計画駆動型のエージェントが堅牢。

- エラー回復は成功率を大幅に押し上げる一方で、無制限リトライはコストとリスクを増大。粒度の良いタイムアウトとリトライポリシーが鍵。

- 観測性の不足は改善サイクルを阻害。MCPレイヤーでの統一ログとトレーシングは不可欠。

導入の流れ(概要)

- 環境準備:Docker/コンテナ実行環境を整備し、ベンチ用リソースとMCPサーバー群を起動。

- モデル接続:評価対象のLLMをMCPクライアント対応のエージェントに接続。権限・シークレットを最小限に設定。

- タスク選択と実行:難易度別のタスクバンドルを選び、固定データで一括実行。ログと成果物は自動収集。

- 採点と分析:成功率・工数・失敗分析レポートを出力。再試行やプロンプト/ポリシー改善の効果を比較。

よくある落とし穴と対策

- 権限が広すぎる:書き込み系はタスク専用ディレクトリに限定。メールはテスト用インボックスに。

- プロンプトが冗長:ツール記述は短く構造化。失敗時の再計画を明示ルール化。

- ツールのエラーメッセージが不親切:MCPサーバー側でエラーコード標準化とヒントを付与。

- 非再現バグ:データセットとモックを固定し、外部ネットワーク依存を最小化。

MCP-Benchを活用するメリット

- 公平なモデル比較:同じタスク・同じツールで横並び比較が可能。

- 改善サイクルの短縮:観測性と失敗分析が統合され、ボトルネックが見つけやすい。

- 安全設計の実装支援:最小権限や監査ログなど、運用要件を最初から組み込める。

- 現場適合:オフィス事務から開発支援まで、実務に近いシナリオで性能を測れる。

まとめ:LLMエージェントの「働きぶり」を見える化する

MCP-Benchは、抽象的な言語タスクから一歩進み、エージェントが実環境でどれほど計画的に、正確に、安全に動けるかを定量化します。MCPという共通レイヤーがツール利用を標準化し、コンテナ化されたベンチが再現性を約束します。自社のエージェント開発・運用において、設計の良し悪しや改善余地を客観的に把握するための“健康診断”として活用すると、現場導入の成功確率は大きく高まるはずです。

実装・評価を始めるためのおすすめアイテム

- ローカルでMCPサーバーを動かす軽量計算機(Raspberry Pi 5など)

- GPUが必要な場合の開発ボード(Jetson Orin Nanoなど)

- コンテナ環境の基礎を固める日本語の入門書

- Amazon: Raspberry Pi 5(8GB)

- Amazon: NVIDIA Jetson Orin Nano Developer Kit

- Amazon: Docker/Kubernetes 入門書(日本語)

- 楽天: Raspberry Pi 5(8GB)

- 楽天: NVIDIA Jetson Orin Nano Developer Kit

- 楽天: Docker/Kubernetes 入門書(日本語)