人工知能や機械学習のブームとともに、自然言語処理(NLP)の分野も急速に発展してきました。その中心にあるのが「Transformers」と呼ばれる技術であり、Hugging Face社が提供する「Transformers」ライブラリは、誰でも簡単に高度なNLPモデルを使えるよう設計されています。しかし、初めて触れる人にとっては「Transformers」という言葉自体に圧倒されてしまうことも少なくありません。

この記事では、Hugging Face公式ブログに掲載された「Total noob’s intro to Hugging Face Transformers(完全初心者のためのHugging Face Transformers入門)」の記事をもとに、プログラミング初心者や機械学習未経験者にも分かるような形で、Hugging Face Transformersの魅力や使い方の基礎をご紹介します。

Hugging Faceとは?

まずはHugging Faceという企業について簡単に紹介しておきましょう。Hugging Faceは、自然言語処理(NLP)の研究とツール開発を行っているスタートアップで、オープンソースに貢献する姿勢でも知られています。「Transformers」と呼ばれるライブラリは、同社が提供する最も人気のあるソフトウェアの一つで、世界中で多くの研究者・エンジニア・開発者によって利用されています。

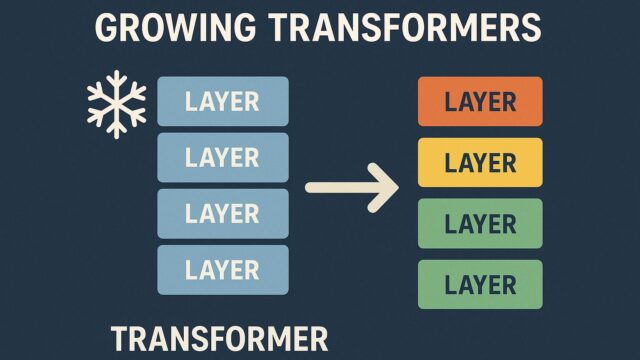

Transformersとは?

「Transformers」とは、自然言語処理をはじめとするさまざまなタスクに用いられるモデルアーキテクチャの名前です。代表的なモデルとして、BERTやGPT、DistilBERTなどが知られており、文章の分類、要約、質問応答、翻訳など多くの用途に活用されています。従来のRNNやLSTMといったモデルに比べて高速かつ高精度で処理が可能な点が特長で、Hugging FaceのTransformersライブラリを使えば、これらの強力なモデルを簡単に利用することができます。

完全初心者でもできる!Transformersライブラリの始め方

この記事の筆者は、まさに「total noob(完全な初心者)」という表現を使って、自分自身が機械学習の知識ゼロ、Pythonの経験も乏しい状態からTransformersの世界に足を踏み入れた様子を紹介しています。その過程をたどることで、読者も「自分にもできるかも!」という気持ちを持つことができるはずです。

Pythonの準備

Hugging Face TransformersはPythonベースのライブラリです。まずはPythonが自分の環境にインストールされているか確認しましょう。Pythonがまだインストールされていない方は、公式サイトからインストールできます。

また、Pythonと一緒に使われる仮想環境(virtual environment)やJupyter Notebook、VS Codeといった開発ツールも合わせてインストールしておくとスムーズです。

Transformersライブラリのインストール

Transformersのインストールはとても簡単です。以下のようにpipコマンドを使って、ターミナルやコマンドプロンプトから操作します:

pip install transformers

この一行だけで、ライブラリ自体とその依存関係が一括でインストールされます。使用する場合は、他にtorch(PyTorch)やtensorflowのインストールも必要な場合があります。

最初の一歩:パイプライン(pipeline)の活用

Transformersライブラリのすばらしい点のひとつとして、「pipeline」という強力なAPIがあります。これは、複雑な設定をせずに、訓練済みのモデルをそのまま使ってNLPタスクを実行できる仕組みです。たとえば、次のようにコードを数行書くだけで文章を感情分析できます。

from transformers import pipeline

classifier = pipeline(“sentiment-analysis”)

result = classifier(“I love using Hugging Face Transformers!”)

print(result)

これで「positive(肯定的)」などの分析結果が得られます。初心者にはこれ以上の手軽さは望めないくらい、簡単に使えることが大きな魅力です。

文章生成にも挑戦

自然言語生成(NLG)は、AIが新しい文や文章を生成する処理です。これもpipelineを使って簡単に実行できます:

generator = pipeline(“text-generation”, model=”gpt2″)

output = generator(“Once upon a time”, max_length=30, num_return_sequences=1)

print(output)

このようにして、GPT-2に代表される言語モデルを使って、物語の続きを自動生成させることができます。

モデルとトークナイザー

Transformersライブラリでは、「モデル」と「トークナイザー」が基本的な構成要素になります。モデル(たとえばBERTやGPT)は、実際に文の処理や生成を行うエンジンです。一方で、トークナイザーは文章をモデルが理解できる形式に変換する役割を持ちます。

初心者にありがちな「モデルを変更しただけでうまく動かない」という悩みも、正しいトークナイザーを使うことで解決できます。多くの場合、”from_pretrained”というメソッドを用いることで、モデルに最適なトークナイザーも自動的に取得される設計になっています。

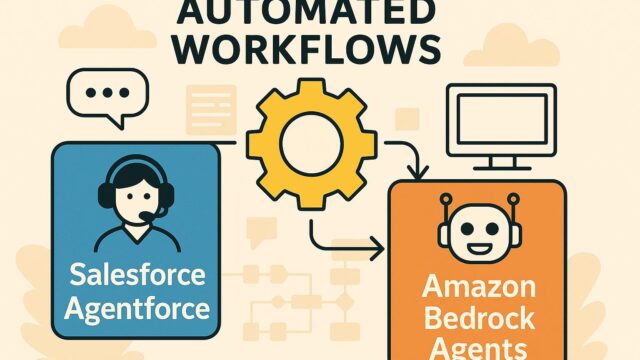

huggingface.coのModel Hubの活用

Hugging Faceのもうひとつの強みが「Model Hub」と呼ばれるプラットフォームの存在です。ここには数千種類以上の訓練済みモデルが公開されており、検索やフィルタ機能を使って自分のタスクに合ったモデルを選ぶことができます。

例えば、「英語から日本語への翻訳」や「スパム検出」「対話応答型チャットボット」など、さまざまな用途に応じたモデルが無料で利用可能です。初心者であっても、適切なキーワードで検索するだけで強力なモデルを手に入れることができるのです。

コミュニティとのつながり

Hugging Faceのコミュニティは非常に活発で、ドキュメントやチュートリアル、フォーラム、GitHubなどで多くの情報がやりとりされています。困ったときに相談したり、自分の体験を共有したりすることは、知識の習得を飛躍的に加速させてくれます。

また、公式のブログやYouTubeチャンネルでも、初心者向けの解説コンテンツが用意されているため、英語が読める方はそちらを活用するのもおすすめです。

実際に手を動かしてみよう

この記事では、あくまで「初心者が初めてTransformersの世界を体験する」ことに注目しています。そのためには、まずは既存のツールやモデルを利用し、試行錯誤を繰り返しながら理解を深めていくことが大切です。すべてを理解してから始めようとせず、「とにかく動かしてみる」「試してみる」という姿勢が成功の鍵です。

まとめ:なにから始めるべきか?

– Python環境を構築する

– pip install transformers でライブラリを導入

– pipelineを使って簡単な自然言語処理を試してみる

– Model Hubで自分の用途にあったモデルを探す

– コミュニティやドキュメントを活用して知識を深める

人工知能や機械学習の世界は、決して専門家だけのものではありません。むしろ、誰でも好奇心と少しの努力で、その一翼を担うことができる時代です。Transformersライブラリは、その入り口として最適なツールです。

この記事を読んで、「ちょっと挑戦してみようかな」と思っていただけたなら、それが何よりの第一歩です。あなたの一歩が、未来を変える可能性を秘めています。さぁ、まずはPythonを開いて、ひとつコードを書いてみましょう。すべてがそこから始まります。