私たちの生活は日々複雑化しています。カレンダーの予定、オンラインショッピング、メールのやり取り、スマートホームデバイスの操作など、デジタル空間でのタスクは増える一方です。こうしたタスクを自動化し、私たちを支援するために登場してきたのが「AIエージェント」です。

たとえば、スケジューラーボットが私たちの代わりに会議の日程を調整したり、チャットボットが顧客対応を自動化したりする光景は、今では見慣れたものとなりました。しかし、これらのAIエージェントが真に私たちの生活に「溶け込む」には、まだ乗り越えるべき課題が多くあります。現実世界は思った以上に複雑で曖昧なものであり、単純な命令やルールではうまく対応できないのです。

この記事では、現代のAIエージェントが直面する課題と、それらを解決しようとする新しい取り組み「MCP(Modular Cooperation Protocol)」と「A2A(Agent-to-Agent)」プロトコルについて紹介します。これらの技術が実現すれば、複数のAIエージェント同士が協力しながら、私たちの生活をよりスムーズにナビゲートしてくれる未来が待っているかもしれません。

AIエージェントの現在地:強力だが孤立している

まず、私たちの周辺で活躍するAIエージェントの現状を考えてみましょう。カレンダー管理アプリはスケジュールを把握し、音声アシスタントは音楽をかけたりニュースを読み上げたり、銀行のチャットボットは残高確認に応えます。それぞれが特定のタスクに特化しており、ある程度は効率的に仕事をこなすことができます。

しかし、これらのAIはあくまで「単独」で動作する存在であり、他のAIやシステムとの連携は限定的です。たとえば、スケジューリングアシスタントが会議の候補日を見つけても、メールアプリに自動的に連絡を送るには、別のアプリケーションとの連携が必要になります。また、出張が決まったとしても、飛行機の予約、ホテルの手配、交通手段の確保といった関連するタスクを一括で行うのは、まだまだ難しいのが現実です。

このように、AIの世界には「協調性の欠如」という問題が存在しています。それを解決しようとするのが、マサチューセッツ工科大学(MIT)の研究チームが開発した「MCP」と「A2A」という2つのプロトコルです。

MCPとA2A:AI同士の言葉を作る

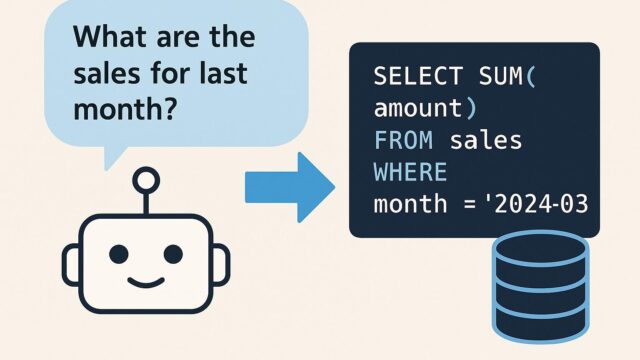

MCP(Modular Cooperation Protocol)は、異なるAIエージェントが共通のルールに従ってコミュニケーションし、タスクを分担・協力できる仕組みを提供します。これは、人間が異なる企業間で協力する際に契約や標準化された文書を用いるのに似ています。AIエージェントも、相互に信頼し、正しく情報を受け渡すためには、統一されたルールが必要なのです。

一方、A2A(Agent-to-Agent)は、MCPの上に構築されたプロトコルであり、AIエージェント同士が直接会話を交わすための言語仕様やフォーマットを提供します。これはまさに「AI同士の共通語」を定義する取り組みと言えるでしょう。

たとえば、あるAIエージェントが「出張のために航空券を予約してほしい」と別のエージェントに依頼する場合、目的地、出発日、希望の航空会社、予算などの情報をどのように伝えるべきかを標準化する必要があります。これを人間で言えば、見積書や発注書のような存在だと考えると分かりやすいかもしれません。

MITが開発したこれらのプロトコルは、すでに数多くのスタートアップや企業によってテストされており、その実用性が注目されています。理論だけでなく、実際に動く「プロトタイプ」が登場してきているのです。

複雑な社会をナビゲートするということ

AIエージェント同士が協力できるようになれば、私たちの生活にどのような変化が訪れるでしょうか?イメージしてみましょう。

たとえば「引っ越し」をする場合、従来なら、不動産サイトを探し、引っ越し業者に連絡し、電気・ガス・水道の手続きを行い、住所変更の書類を提出し、最寄りの学校や職場へのルートを確認するなど、非常に多くの作業が必要です。

もし、AIエージェント同士がMCPやA2Aを通じて連携できれば、スマートフォンに「来月、○○市に引っ越す予定」と伝えるだけで、以下のような一連の作業が自動的に進行するかもしれません。

– 新居候補を提案し、内見の予約を手配

– 最適な引っ越し業者を見積もり

– 各種ライフラインの移転手続き

– 家族の新しい通勤・通学ルートのナビゲーション

– 郵便局への転送届の提出

このように、AIエージェントが協調して働くことで、私たちの生活はより効率化され、ストレスの少ないものになります。

信頼と透明性がカギ

とはいえ、AI同士が連携して自律的に行動するようになるには、大きな課題も存在します。その中でも特に重要なのが「信頼性」と「透明性」です。

私たちは、AIが提案した行動の理由や経路を理解できなければ、不安を感じるものです。たとえば、ホテルの予約を自動でしてくれたとしても、「なぜこのホテルなのか?」「他の選択肢はなかったのか?」といった疑問が湧くのは自然なことです。

そこでMITの研究チームは、AIの行動や意思決定の「ロジック」を記録・開示できる仕組みも設けています。ユーザーは、AIが他のエージェントとどうやり取りをし、どんな判断をして行動したのかを確認することができるようになるでしょう。

このように、AIがより人間に近い、あるいは「チームの一員」として機能するには、「説明責任」や「透明性」といった倫理的観点も非常に重要になってきています。

未来へ向けた第一歩

MCPとA2Aは、完全なAI社会の実現に向けての第一歩とも言える取り組みです。まだすべてが整っているわけではありませんが、実験によってその有効性が次々と明らかになっており、多くの企業や研究者がこの分野に興味を示しています。

これから先、AIエージェントが単なる道具から「意思疎通ができるパートナー」として私たちの生活に入り込む時代が来るのかもしれません。そのとき、私たちはAIとどのように向き合っていくべきなのでしょうか。

それは決して奇抜なテクノロジーの話ではなく、誰もが恩恵を受けられる、きわめて実用的で日常的な話題なのです。MCPやA2Aのようなプロトコルを通じて、AIがより「人間らしく」なることが、私たちの暮らしを豊かにする大きな鍵になるのではないでしょうか。

テクノロジーの進化には、確かにまだ課題が残されていますが、それでも一歩一歩着実に、人とAIの理想的な共存に向けた道が築かれつつあります。未来の生活を、よりスムーズで、安心して任せられるものにするための重要な研究と実装が、今まさに進行しているのです。