AIが「画像で考える」時代へ──マルチモーダル推論の新たな潮流と技術的進化

AIが文章だけでなく、画像も使って「考える」ようになってきています──これはマルチモーダルAIの分野における大きなパラダイム転換と言えるでしょう。この記事では、AIが「画像について考える」段階から「画像で考える」段階への進化の道筋を中心に、最新の研究成果の紹介を交えながら、技術的な背景と今後の可能性をわかりやすく解説します。

画像はただの入力ではない。「思考の媒体」になり始めた

これまでのマルチモーダルAI、特に「マルチモーダル推論(Multimodal Reasoning)」では、主にテキスト(文章)を通じて思考が行われていました。たとえば画像を見せた後、その画像に関する質問に対してAIが文章で答える――こうした処理は主にテキストベースの「チェーン・オブ・ソート(Chain of Thought:CoT)」と呼ばれる推論技術に基づいています。

しかしこの方法では、画像は初期の「文脈情報」として利用されるだけで、思考の途中で再び視覚的な操作を行うことはありません。結果として、「リッチな視覚的情報」と「記号的な言語思考」との間に、いわゆる“セマンティックギャップ(意味的な隔たり)” が生じていました。

人間はどうしているでしょうか。私たちは複雑な問題を考えるとき、心の中でイメージを描いたり、図を書いたりして整理しますよね。つまり視覚情報は、思考の静的な背景ではなく、むしろ「可視的なメモ帳」のような道具なのです。この人間の認知モデルを模倣しようとするのが、今起きているAIの次なる段階、「画像で考える(Think with Images)」という新しいパラダイムです。

「画像で考えるAI」が辿る3つの進化段階

「Think with Images」という未来を目指したAIの進化は、以下の3段階のフェーズに分けて整理できます。

1. 外部ツールによる視覚的思考(External Tool Exploration)

最初の段階では、AIが外部の描画ツールやスケッチ機能を使って、自身の思考過程に視覚的な表現を取り入れることが行われています。例えば、数学の問題を解くときに図形を描いたり、空間的な関係を把握するためにイメージを作成したりすることです。

ChatGPTなどの大規模言語モデルにビジュアライゼーション機能を持った外部APIを連動させることで、言語と視覚のハイブリッド型推論が実現され始めています。この段階ではまだ、画像はAIの「外」にあります。

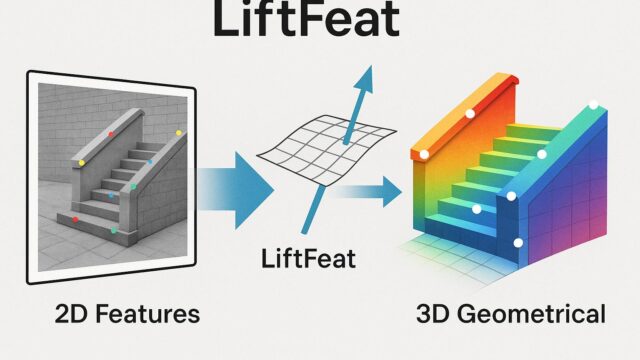

2. プログラム的操作による視覚思考(Programmatic Manipulation)

次の段階では、AIが自身で視覚情報を生成・編集しながら推論する能力を持ちます。たとえば、仮定に基づいてシーンを再構築して検証したり、物体の動きをシミュレーションするなど、視覚的な世界を「操作する」ことで答えにたどり着くことが可能になります。

これを支える技術として中心的なのが、画像生成技術(拡散モデルやVAEなど)と、画像編集APIとの連携です。OpenAIのDALL·EやMetaのSegment Anything、さらには3Dシミュレーション環境との統合などがこの技術を加速しています。

3. 内在的イメージ想起(Intrinsic Imagination)

最終的には、AIが内部的に想像力を持ち、「見る前に思い描く」能力を持つようになります。これは、視覚が完全にAIの認知構造に組み込まれ、外部ツールに頼らずとも、自身の内部状態の中にビジュアルなメモリや仮想世界を保持して推論できる段階です。

ここでは、人生経験のような視覚的記憶や、物理法則に準じた視覚的直観を活用してより人間らしい推論が可能になります。技術的には、視覚的なエピソード記憶や、内省的な「ビジュアル思考プロセスモデル」が肝になるでしょう。

技術的な基盤と評価の課題

このような進化には、複数の技術的支柱と、それを評価・検証するための基準が欠かせません。

基盤技術としては、以下のような分野の急速な進化が貢献しています:

– 大規模画像生成AI(例:Stable Diffusion, DALL·E 3)

– マルチモーダルTransformers(例:CLIP, Flamingo, GPT-4Vなど)

– 強化学習を取り入れたタスクベースのメタ認知機能

– シミュレータ連動による空間認識とアフォーダンス理解

さらに今後の鍵になるのが、「どうやって“画像を使って考えている”AIの知能を評価するか?」という問題です。従来の自然言語ベンチマークだけでは限界があるため、マルチステップの視覚的問題解決や、認知科学に基づいた新しい評価方式の開発が重要です。

そして未来へ:より人間に近いAIへ進化する礎

この「画像で考える」パラダイムは、マルチモーダルAIを単なる情報処理装置から一段階進化させ、人間らしい思考のメカニズムに近づける鍵となります。

視覚と推論の統合により、AIは空間的な関係を理解したり、図的推論を行うことが可能になり、教育・医療・設計など、極めて多岐にわたる応用が期待されます。

私たち人間がスケッチを描いたり、頭の中でイメージを動かしながら考えるように、AIもまた「見て」、「描いて」、「考える」ことができる──こうした未来が、すでに現実の一歩手前まで来ているのです。

今後は、視覚以外のモダリティ(例:音、触覚など)とも統合した「真のマルチモーダル知能」に向かって、AI研究はさらに進化していくことでしょう。我々がどこまでAIに“想像”させるのか、それをどう制御し共生していくのかが、これからの重要な問いになります。