2024年5月、Hugging FaceはAI技術の新たな地平を切り開くべく「Transformers Agents 2.0」を発表しました。このアップグレードは、「License to Call(呼び出す権限)」というキャッチーなタイトルにも表れている通り、AIモデルの柔軟性と実用性を飛躍的に高めるもので、多くの開発者や研究者にとって非常に魅力的なツールとなる可能性を秘めています。本記事では、Transformers Agents 2.0の概要とその特徴、利用方法の進化、将来の展望について詳しく掘り下げていきます。

Transformers Agentsとは何か?

まず「Transformers Agents」とは、簡単に言うと、複数のAI機能(たとえば画像認識、テキスト生成、ウェブ検索など)を統合し、ある目的を自律的に達成する「エージェント」を構築するためのフレームワークです。これは従来のシンプルなプロンプト対応の大規模言語モデル(LLM)とは異なり、タスクに応じてツール(APIや他のモデルなど)を自動的に選び取り実行する能力を持ちます。

Transformers Agentsの最大のアピールポイントは、Hugging Faceが提供する「Transformers」「Datasets」「Inference Endpoints」などの豊富なエコシステムとの統合により、非常にシンプルなインターフェースで高度な機能が利用可能になる点です。

Agents 2.0で何が変わったのか?

「Transformers Agents 2.0」は、従来の1.0バージョンで得たフィードバックを元に、多くの点で改良が加えられています。特に注目すべきは以下の3点です。

1. 新しい実行エンジン「Transformer Executor」

Agents 2.0では、新しい実行構造「Transformer Executor(TE)」が導入されました。これは従来の「ReAct」や「Agent Toolkit」から一新され、コミュニケーションの透明性や柔軟性が大幅に向上しています。複雑な命令にも対応できるようになり、複数ステップの処理をエージェントが自律的に実行・判断できるようになりました。

特筆すべきは、タスクが失敗した場合や途中で中断された場合にも、ユーザーにその理由を明確に示す機構が導入されている点です。これはAIとのやりとりにおいて重要な「説明可能性(explainability)」を高める要素として非常に有用です。

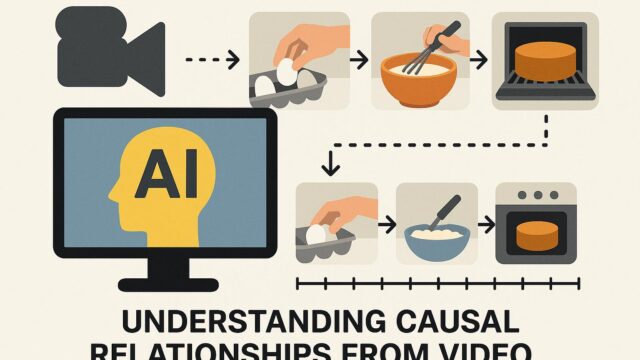

2. マルチモーダル処理への対応

Agents 2.0では、画像や音声、動画など、テキスト以外のデータ形式もよりスムーズに扱えるよう進化しました。たとえば、ある画像に含まれる情報を読み取り、それに対応したインターネット検索を行い、結果を要約して提示する、といった複合的な処理が、シームレスに実現可能になります。

これにより、従来のチャットボットやシングルタスクに強いAIを超えた、汎用的で直感的なAI体験が可能になりました。特に教育、ヘルスケア、Eコマース、ビジネスインテリジェンスといった分野での応用が期待されています。

3. HuggingGPTとの統合

OpenAIのChatGPTと似たコンセプトとして、Hugging Faceでも「HuggingGPT」というモデルベースのエージェント構造を提案しています。このHuggingGPTはAgents 2.0と統合され、多数の小規模・特化型モデルの連携によって、一つの大きな課題を解くための「集団知能」的なアプローチを可能にします。

これにより、たとえば言語生成はあるモデル、画像タグ付けは別のビジョンモデル、検索や推薦はまた他の専用モデルが実行し、それらを調和的に組み合わせることで、より正確で効率的な結果が得られます。

使い方と実用性の向上

Hugging Faceの魅力の一つに、開発者や非エンジニアでもアクセスしやすいユーザー体験があります。Transformers Agents 2.0でも、従来通り非常に少ないコード行数で動作させることができます。たとえば、

from transformers import TransformersAgent

agent = TransformersAgent(tool=”huggingface-tools”, model=”google/flan-t5-xxl”)

response = agent.run(“Please generate a summary of the latest NASA Mars mission.”)

上記のように、数行で最新技術を活用することができ、ブラウザ上のインターフェースからでも実行可能です。さらに、新しく導入された「Agents Playground」というウェブUIでは、ノーコードでエージェントの動作を確認・編集・再実行でき、学習用途にも最適です。

今後の可能性とエコシステムとの連携

Transformers Agents 2.0は、単なるAIツールの機能拡張に留まらず、AIの民主化(democratization)をさらに一歩前進させる存在です。たとえば教育分野では、自律的に問題を分析し、ユーザーに合わせて学習コンテンツを提供するAIチューターの構築が可能です。医療分野では、症状に応じて複数の資料を参照し、より正確な情報を患者や医師に提供するような活用も考えられます。

さらに、Hugging FaceのHubには多数のオープンソースモデルが登録されており、これらをエージェントの一部として自由に組み込むことができます。これにより、特定の目的に合わせてエージェントのスキルセットをカスタマイズすることが可能となり、まるで「自分だけのAIチーム」を編成していくような体験が、簡単なコードだけで実現できてしまうのです。

終わりに:AIの自由度と信頼性の向上へ

Transformers Agents 2.0のリリースは、AI技術がより実用的でパーソナライズされた方向へ進んでいることを如実に示しています。また、今回のアップデートで特徴的だったのは、単なるパフォーマンス向上だけでなく、「使いやすさ」「透明性」「柔軟性」といった、人とAIの円滑な共存に不可欠な要素が強調された点です。

「License to Call(呼び出す権限)」というタイトルには、まさにこれからのAIに対する私たちの役割や関わり方が問われているというメッセージが込められているように感じます。誰もが自分専用のAIアシスタントを持ち、それを自在にカスタマイズ・拡張・共有できる――そんな未来が、もう目前に迫っているのです。

これからもHugging Faceのこうした取り組みには大きな注目が集まることでしょう。AIがより広く、誰にとっても使いやすくなるように進化していく中で、「Transformers Agents 2.0」はその先頭を走る重要なステップです。是非一度試してみて、自分だけのエージェントを育てる体験をしてみてはいかがでしょうか。