近年、生成AIの急速な発展により、人工知能を安全かつ信頼できる形で社会に導入するための研究が盛んになっています。しかし、その中で「重要な部分が抜け落ちているのではないか?」という疑問が研究者たちの間で浮かび上がってきました。その問題を鋭く指摘したのが、2025年3月までに公開された9,439本もの生成AI関連論文の中から、安全性や信頼性に焦点を当てた1,178本を分析した最新の研究です。本稿ではその内容を技術的観点から分かりやすく解説しながら、日本社会におけるAIの活用に向けて考えるべきポイントを紹介します。

■ コーポレートAI研究は「開発前」に偏重している

この分析では、世界をリードするAI開発企業 — Anthropic、Google DeepMind、Meta、Microsoft、OpenAI — と、トップクラスの研究機関(MITやスタンフォード大学など)が発表した論文の傾向を比較しました。その結果、企業系の研究は「事前段階」、すなわちモデルの設計や訓練段階における整合性の確保(alignment)やテストと評価(testing & evaluation)に集中していることが明らかになりました。

一方で、「実際にAIがユーザーと接する場面」— いわゆるデプロイメント(運用・展開)段階 — における課題、例えばバイアス(偏見)、誤情報の拡散、中毒性機能、著作権侵害といった問題については、研究の量も少なく、進展が限定的です。

■ 見逃されている”高リスク領域”

医療や金融といった高リスク分野においてAIを導入する場合、その影響は人命や財産に直結するだけでなく、誤った判断が社会全体に大きな被害をもたらす可能性があります。にもかかわらず、これらの分野でのAI運用に関する研究は著しく不足しています。たとえば、

– 医療における誤診・誤情報のリスク

– 金融取引におけるAIの裁量判断の透明性

– SNS上での偽情報の拡散やアルゴリズムによる認知バイアスの助長

– 子供や若年層への中毒性を帯びたレコメンド機能

– AIが生み出す創作物と著作権の境界

といった問題は、どれも解決されていない、あるいは十分な研究がされていないまま、ハイスピードで商業的に導入され続けています。

特に生成AIの誤情報(いわゆる「ハルシネーション」)や擦り込みのような説得的表現、中毒性のあるUI設計などは、アルゴリズムの「社会的責任」が非常に問われるテーマです。にもかかわらず、企業の多くは収益性の高い開発前フェーズに注力をし、リスクを孕む運用段階の透明性を後回しにしている現状があります。

■ 技術的課題:デプロイ後の「可観測性」が足りない

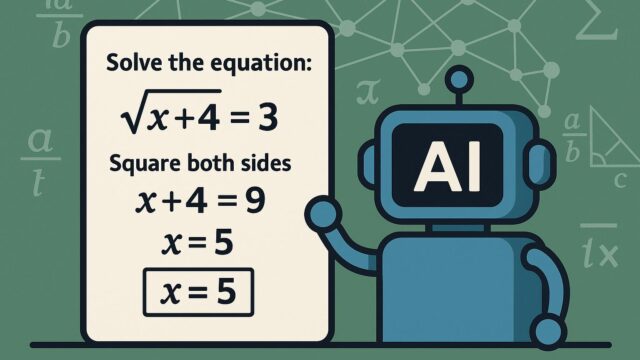

この研究が指摘する大きな技術的ギャップが「observable AI」 — つまり導入されたAIが実際にどのように挙動しているか、ユーザーとどのように相互作用しているかを客観的・継続的に観測できる仕組みの不足です。

例えば、自動運転車には走行中のログデータが記録され、事故が起きた際の原因分析が可能ですが、生成AIの場合、同様の監視能力が企業内部に限られがちで、外部研究者はモデルの運用データにアクセスできないことが多いのが実情です。

これは技術的にも社会制度的にも非常に大きな課題です。なぜならAIの判断結果に責任を問うには、その判断過程(どんなデータから、どんなロジックで結論が導かれたか)を追跡できる必要があるためです。特に大規模言語モデル(LLM)はブラックボックス度が高く、外部からの検証が難しい仕組みになっています。つまり、「使いながらモニタリングする仕組み」=可観測性が鍵になります。

■ 課題解決に向けた提案:外部アクセスの拡大と制度設計

本研究が提案する具体的な解決策は、以下の2つです。

1. 外部研究者によるモデルの運用データへのアクセス拡大

企業の持つ運用データを匿名化・セキュアに共有し、大学や非営利団体の研究者が社会的リスクを検証できるようにすることで、健全な検証サイクルを確立できます。

2. AIの「市場運用中の挙動」に対する制度的モニタリングの確立

AIが商用サービスとして展開されている現場においても、各国の規制機関や第三者監査機関が継続的にその挙動をモニタリング・評価する仕組みが必要です。これはいわば「AIに対する車検制度」のようなイメージです。

■ まとめ:ガバナンス・仕組み化こそ今、必要

生成AIは私たちの生活、生産性、表現活動といったあらゆる領域に浸透しつつあります。その中で技術的には非常に精緻であっても、社会的側面では「安心して使えるか」「トラブル時に責任が追えるか」といった基盤が整っていなければ、結局、人々との信頼関係は構築できません。

「どこに、どのレベルのリスクが存在するのか」を可視化し、民間企業・研究機関間の連携を通じて透明性を担保する“観測システムとガバナンスの仕組み化”が、これから必要不可欠になってゆくでしょう。

特に日本のAI政策においても、こうした研究に学び、産官学が連携して「運用フェーズ」に目を向けた新しいAI安全基準の策定が急がれています。目先の利便性だけでなく、“導入後”のガバナンスを考えることが、真に人間中心のAI社会への第一歩となるのです。